使用第三方和本地模型。

默认情况下,AI Assistant 会通过 云端模型 集合,结合 JetBrains AI 服务 ,提供对各类 AI 提供商的访问权限。 这些模型为 AI Assistant 功能提供支持,并可在 AI Chat 中选择,用于与您的代码库对话。

此外,您可以配置 AI Assistant 使用本地托管模型或第三方提供的模型。 支持的提供商包括:

Anthropic – 提供 Claude 系列模型。

Gemini – 提供 Gemini 模型系列。

Google Vertex AI – 通过 Vertex AI 提供 Google 模型的访问权限。

OpenAI – 提供 GPT、o-series 及其他通用模型。

通过配置来自不同来源的模型,您可以控制 AI Assistant 使用哪些模型以及这些模型的提供方式。

访问第三方 AI 提供商的模型

要访问第三方提供商的模型,AI Assistant 需要 API 密钥,部分情况下还需其他配置。 输入密钥后,AI Assistant 可与提供商进行身份验证并访问其模型。

提供 API 密钥的方法:

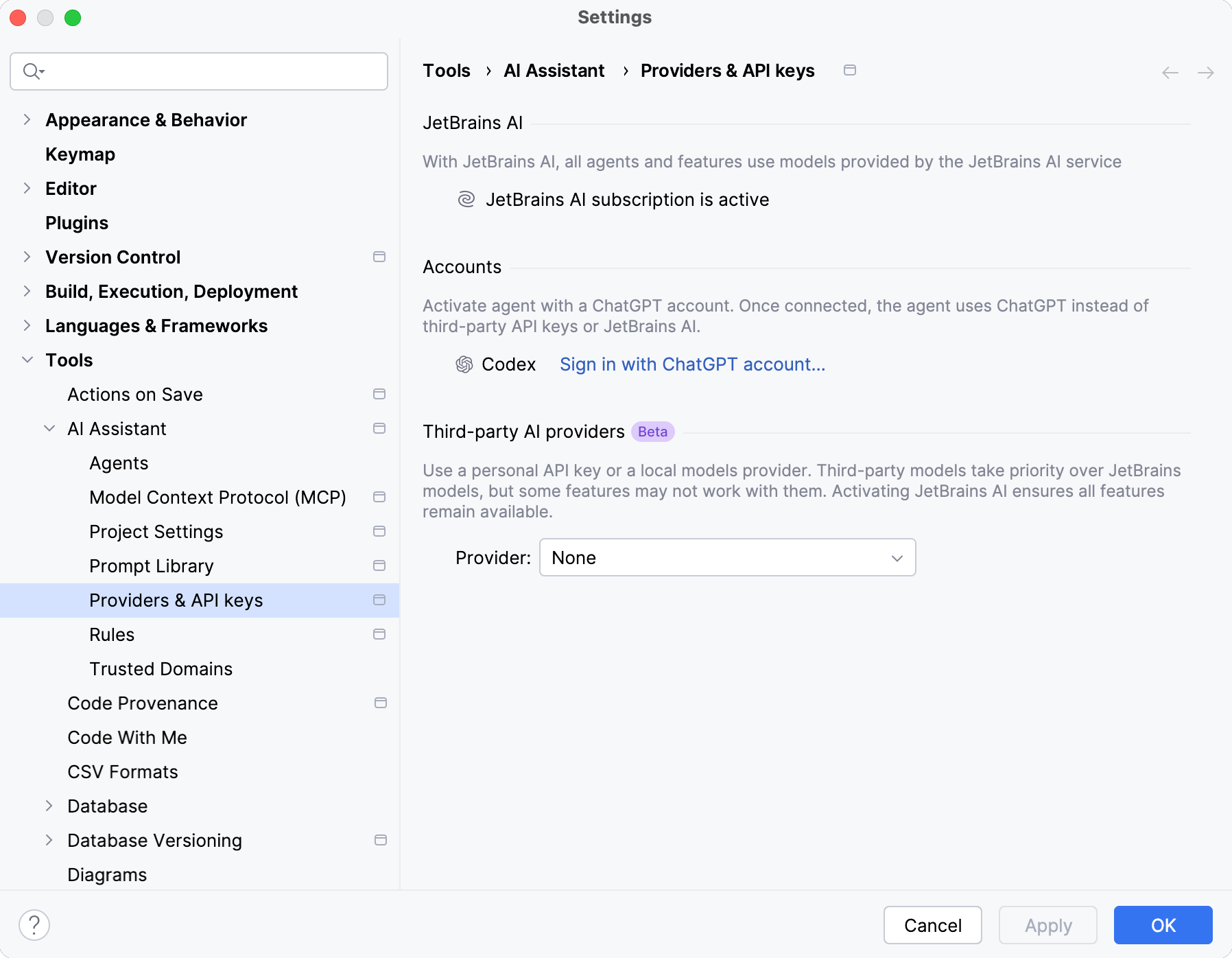

请导航至 。

在 第三方 AI 提供商 部分,选择 提供商。

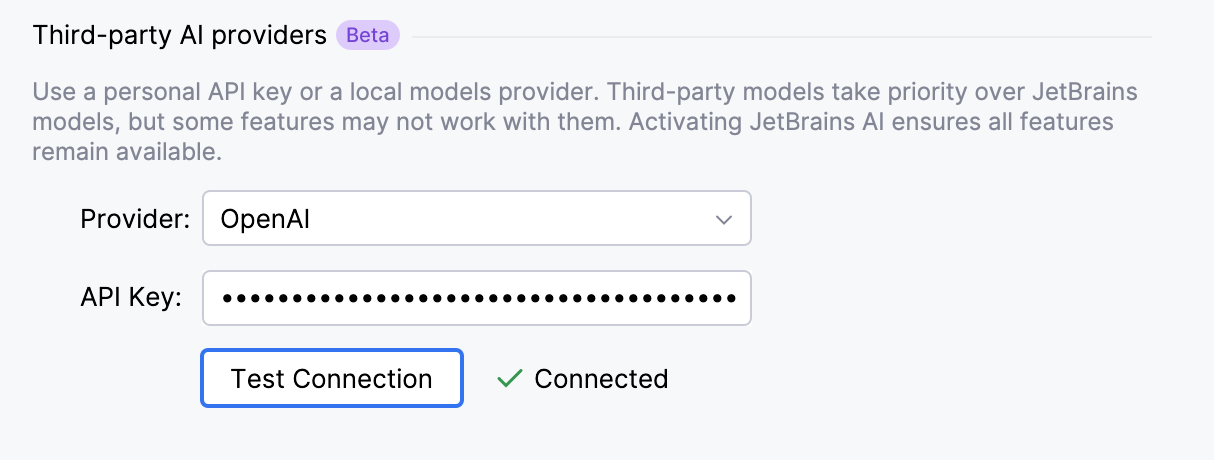

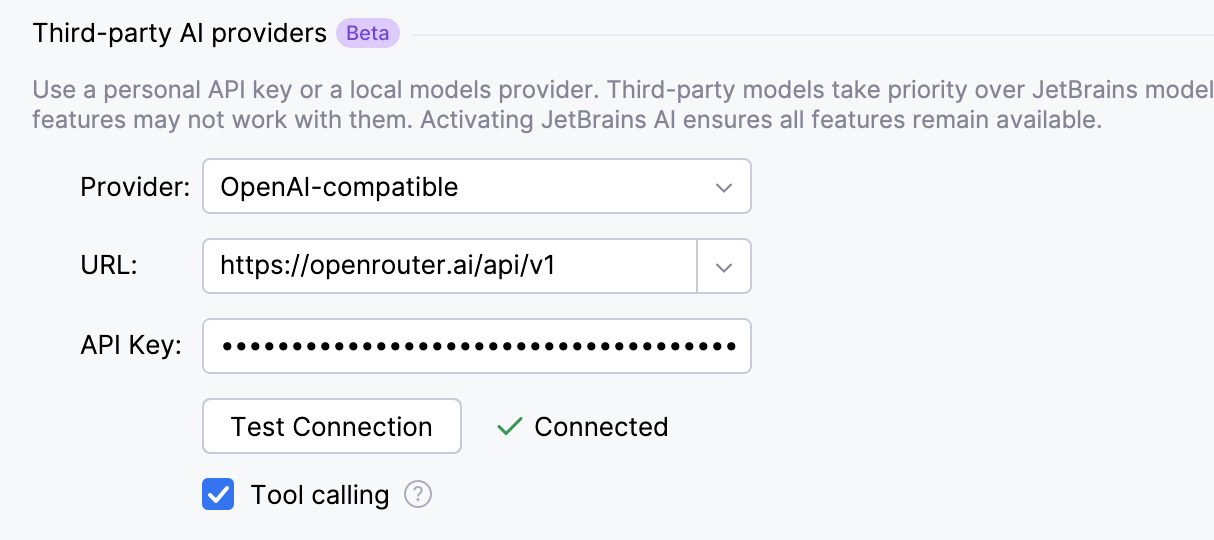

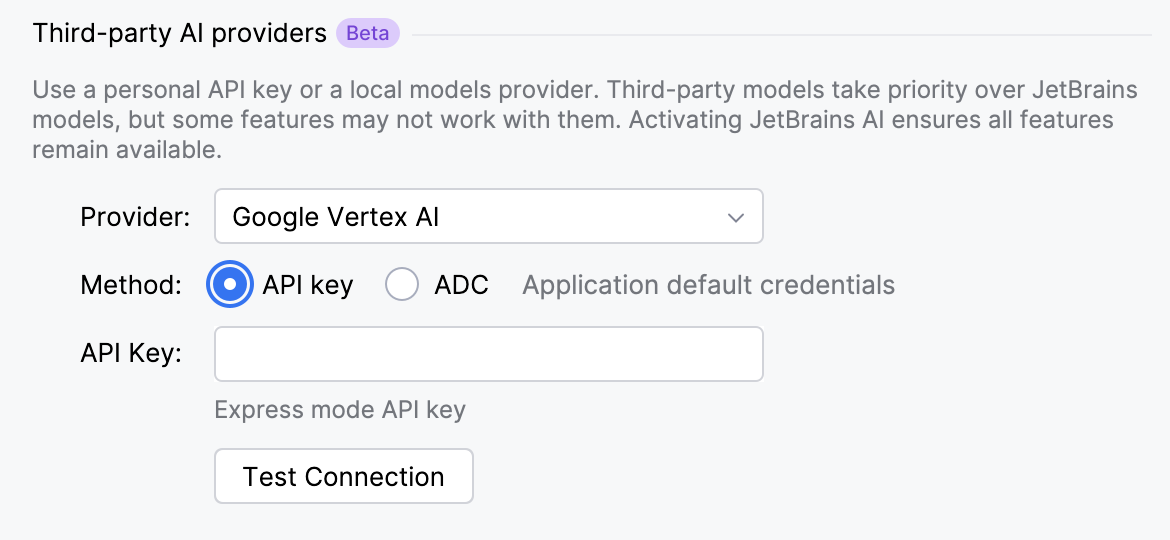

配置提供商设置。 根据所选提供商,配置可能不同:

输入 API 密钥 并点击 测试连接 以检查连接是否成功建立。

指定提供商 API 端点的 URL。

请输入您的 API 密钥。

启用或禁用 工具调用 设置,以指定模型是否支持通过 模型上下文协议(MCP) 配置的工具调用。

点击 测试连接 以检查连接是否成功建立。

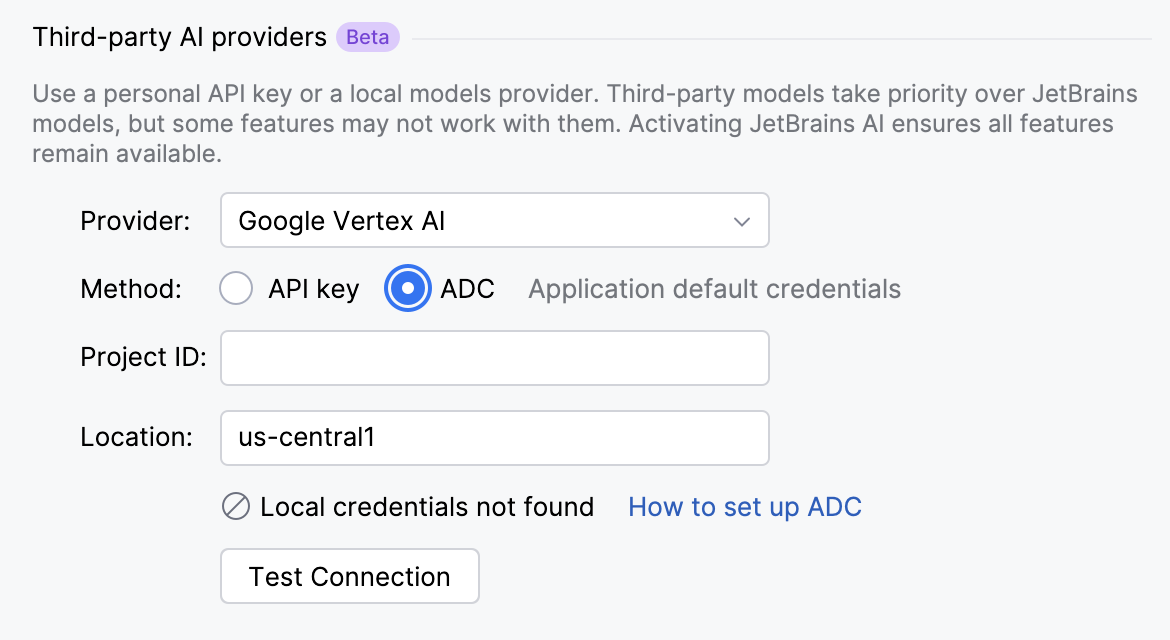

选择身份验证 方法。 有两种可能的选项:

API 密钥 – 使用 Vertex AI express mode API 密钥进行身份验证。

ADC(应用程序默认凭据) – 一种 Google Cloud 身份验证方式,使用在本地环境(如本地 Google Cloud 配置或服务账号)配置的凭据对请求进行授权。

此方法还需指定 项目 ID 和 位置 参数。

点击 测试连接 以检查连接是否成功建立。

点击 Apply 以保存更改。

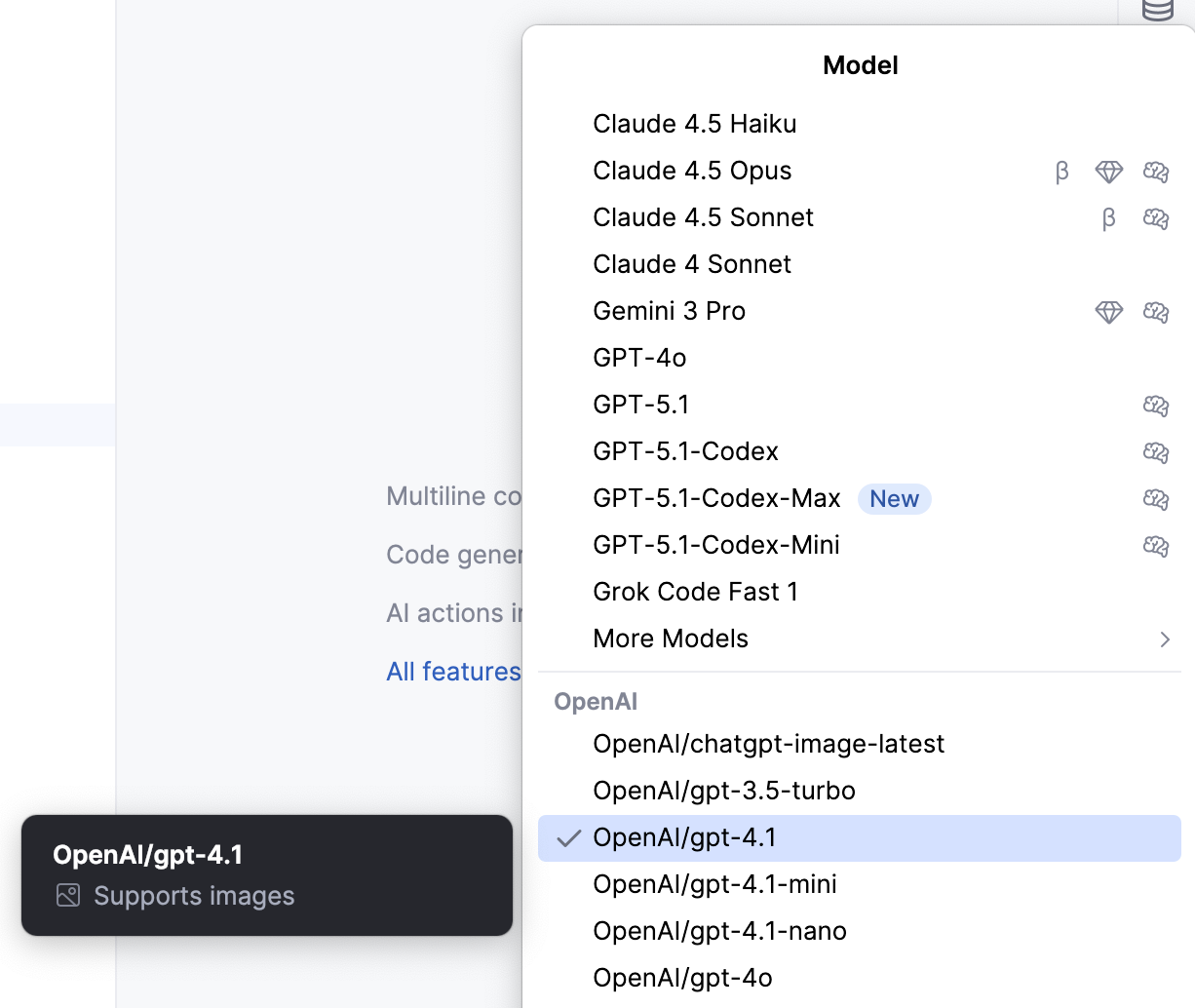

要验证配置的提供商的模型是否可用于使用,请打开 AI Chat 并点击模型选择器。 提供商的模型会显示在相应的区块下。

从第三方 AI 提供商访问的模型会自动分配给 AI Assistant 功能。 如果这些模型不支持某些 AI Assistant 功能,则这些功能将不可用。

有关用于 AI Assistant 功能的模型的更多信息,请参阅 已分配和回退模型列表。

连接本地模型

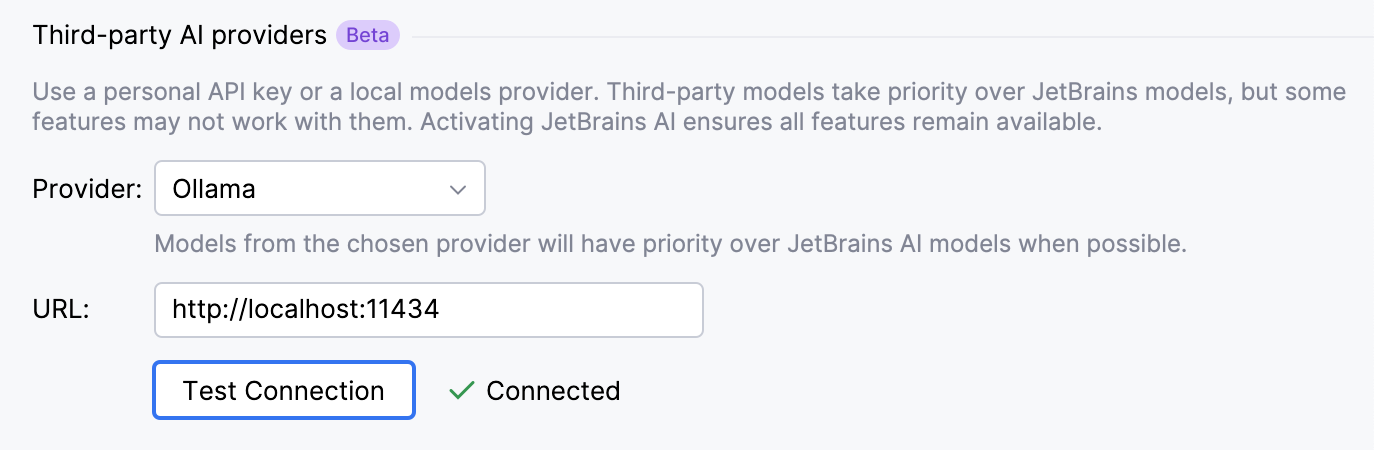

Ollama 和 LM Studio 等提供商会在您的计算机上运行模型。 在 AI Assistant 中连接到这些提供商后,您即可通过本地环境直接使用这些模型。

请导航至 。

在 第三方 AI 提供商 部分,选择 提供商。

指定其可访问的 URL ,并点击 测试连接 以检查连接是否成功建立。

点击 Apply 以保存更改。

连接建立后,本地模型即可在 AI Chat 中使用。 此外,本地托管的模型也可以被 分配到特定 AI Assistant 功能。

为 AI 助理功能分配模型

每个 AI Assistant 功能都有一份 预定义模型列表分配给它。 这些模型会在该功能被触发时使用。 某些功能还有一份 回退模型的预定义列表,如果没有可用的已分配模型,则会使用这些回退模型。

当功能被触发时,AI Assistant 会检查您可用的模型中是否有与该功能分配的模型匹配的项。 如果未找到匹配项且该功能定义了回退模型,系统会在回退模型中查找匹配项。 如无兼容模型可用,则该功能不可用。

该机制的工作方式如下:

默认情况下,AI Assistant 功能使用 JetBrains AI 服务提供的模型,从而确保所有功能可用。

不过,也可以将第三方 AI 提供商或本地模型用于 AI Assistant 功能。 根据模型来源,模型的分配方式会有所不同:

模型来源 | 功能支持 |

|---|---|

第三方 AI 提供商 | 模型会自动分配给功能。 如果提供商模型不支持某一功能,则该功能不可用。 |

本地模型和来自 OpenAI 兼容端点的模型 | 可以手动将模型分配到 AI Assistant 功能组。 |

要将本地模型和从 OpenAI 兼容端点访问的模型分配给 AI Assistant 功能:

转到 。

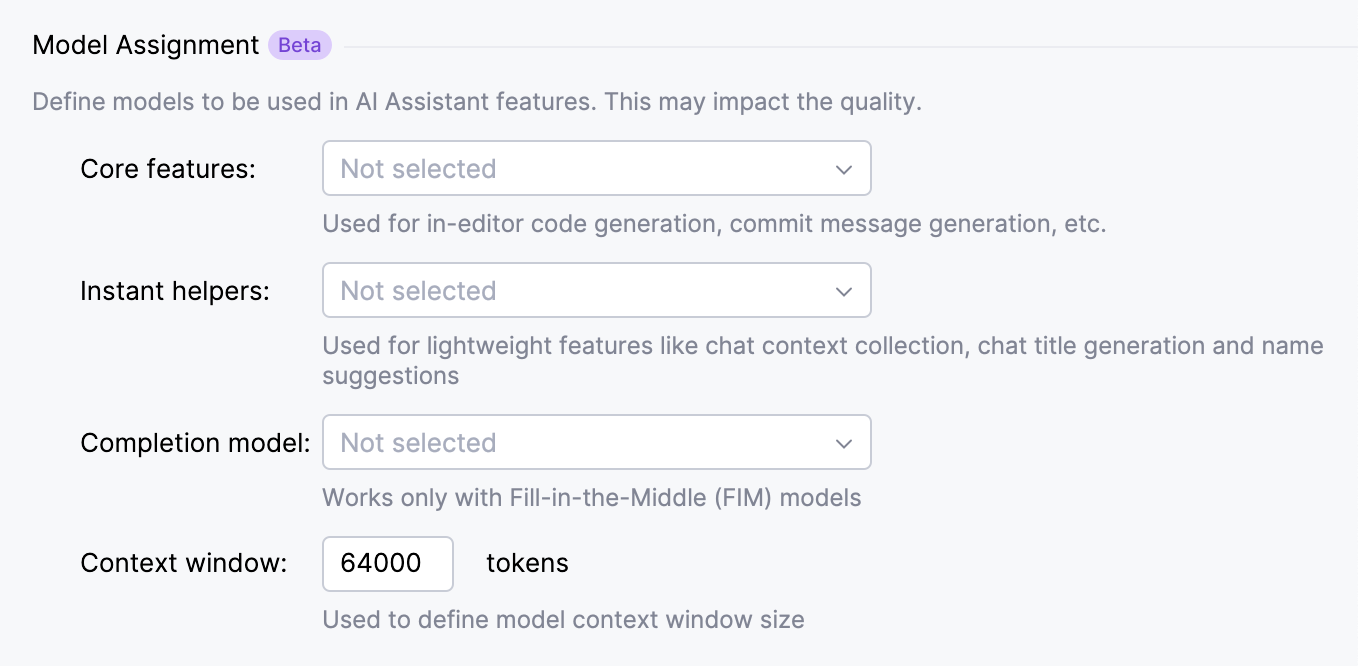

在 模型赋值 部分,指定要用于核心、轻量和代码补全功能的模型。 如有需要,还可以设置模型上下文窗口大小。

核心功能 – 此模型将用于编辑器内代码生成、提交消息生成、聊天默认模型及其他核心功能。

即时帮助程序 – 此模型将用于轻量级功能,如聊天上下文收集、聊天标题生成和名称建议。

补全模型 – 此模型将用于编辑器中的 内联代码补全功能。 仅适用于 Fill-in-the-Middle (FIM) 模型。

上下文窗口 – 允许您为本地模型配置 模型上下文窗口。 较大的窗口可让模型在请求中处理更多上下文,而较小窗口可减少内存使用并可能提升性能。 这有助于在上下文长度与系统资源之间实现平衡。 默认值为 64 000 个 token。

点击 Apply 以保存更改。

因此,当相应功能被触发时,AI Assistant 会使用分配的模型。

已分配和回退模型列表

本节列出了 AI Assistant 功能及其所需的模型,帮助您评估与第三方提供商模型的兼容性。

核心功能

功能 | 应用领域 | 使用的模型 |

|---|---|---|

编辑器 |

| |

编辑器 |

| |

编辑器 |

| |

AI 修复(仅适用于 RustRover) | 编辑器 |

|

VCS |

| |

VCS |

|

即时帮助程序

功能 | 应用领域 | 使用的模型 |

|---|---|---|

AI 聊天 |

| |

文件名生成 | AI 聊天 |

|

聊天上下文收集 | AI 聊天 |

|

聊天标题生成 | AI 聊天 |

|

编辑器 |

|

补全模型

功能 | 功能调用位置 | 使用的模型 |

|---|---|---|

编辑器,AI Chat,提交信息 |

| |

编辑器,AI Chat,提交信息 |

|

回退模型

对于支持回退的功能,此列表会与您可用的模型进行比对。 若未找到匹配模型,则该功能不可用。

以下模型被定义为回退模型:

Anthropic 模型:Claude 4.5 Sonnet,Claude 4 Sonnet,Claude 3.7 Sonnet,Claude 3.5 Sonnet,Claude 4.5 Haiku,Claude 3.5 Haiku

Google 模型:Gemini 2.5 Pro,Gemini 2.5 Flash,Gemini 2.0 Flash

OpenAI 模型:GPT-4o,GPT-4o mini

阿里巴巴模型(仅限中国大陆):Qwen Max

与自定义模型一同启用 JetBrains AI

部分功能可能无法与第三方 AI 提供商的模型一起使用。 为确保所有功能都可用并按预期工作,您可以激活 JetBrains AI 服务订阅。

如需启用 JetBrains AI 订阅:

请导航至 。

在 JetBrains AI 部分,点击 激活 JetBrains AI。

点击 登录 JetBrains 帐户 ,输入您的凭据,并等待登录过程完成。

使用绑定有效 JetBrains AI 订阅的 JetBrains Account 登录后,您即可以完整功能使用 AI Assistant。