HDFS

Remote ファイルシステム プラグインをインストールする

この機能は、プラグインに依存しています。プラグインをインストールして有効にしてください。

Ctrl+Alt+S を押して設定を開き、 を選択します。

Marketplace タブを開き、 リモートファイルシステムプラグインを見つけて、 インストール をクリックします (プロンプトが表示されたら、IDE を再起動します)。

HDFS サーバーに接続する

「Big Data Tools 」ウィンドウで「

」をクリックし、「HDFS 」を選択します。

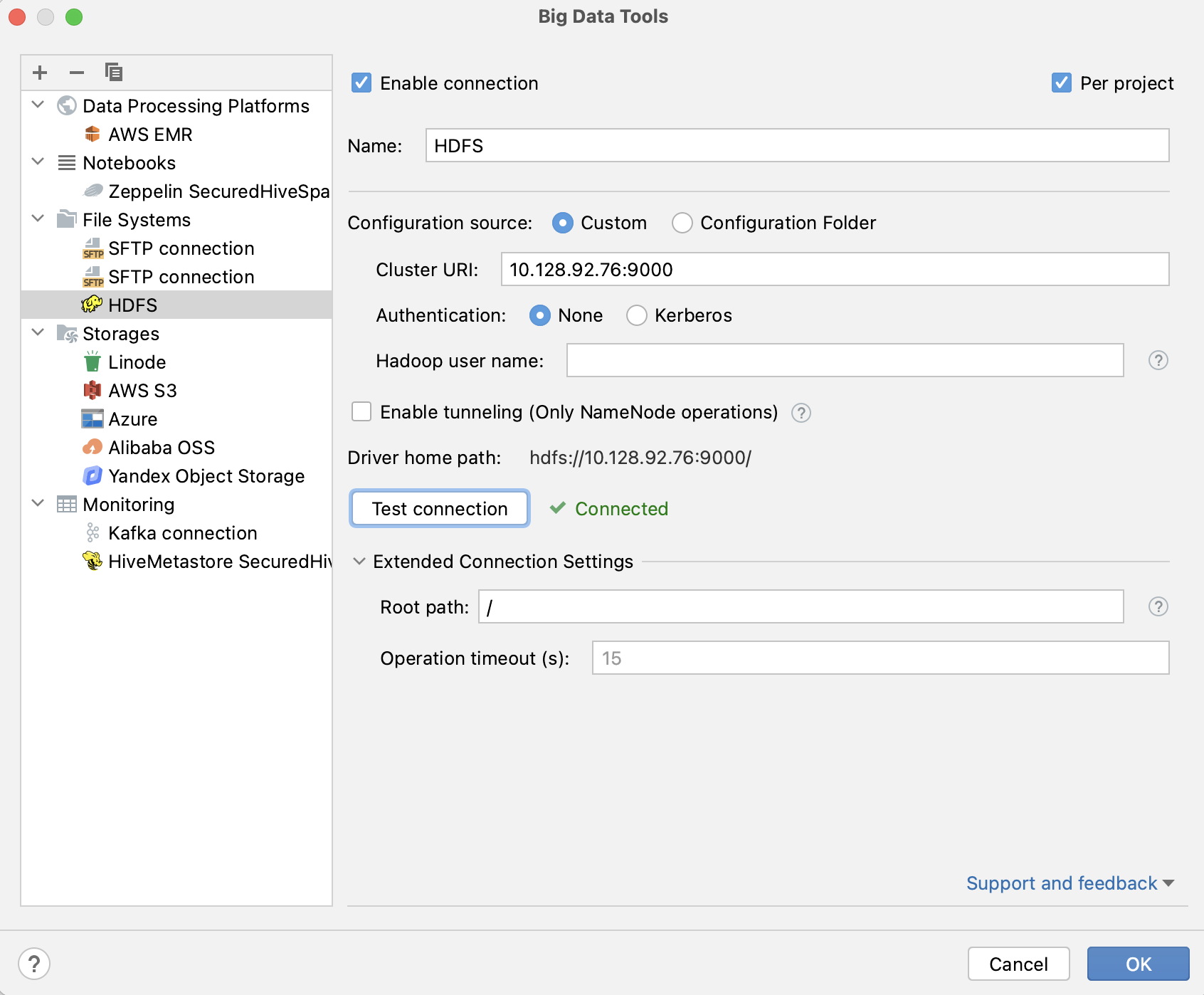

開いた Big Data Tools ダイアログで、接続パラメーターを指定します。

名前: 他の接続と区別するための接続の名前。

構成ソース で、次のいずれかを選択します。

オプションで、次を設定できます。

プロジェクト単位 ごと: これらの接続設定を現在のプロジェクトでのみ有効にするには、チェックボックスをオンにしてください。 この接続を他のプロジェクトでも表示したい場合は、チェックボックスをオフにしてください。

接続を有効にする: この接続を無効にする場合は、チェックボックスをオフにしてください。 デフォルトでは、新しく作成された接続は有効になっています。

Hadoop ユーザー名: サーバーにログインするためのユーザー名を入力します。 指定しない場合、

HADOOP_USER_NAME環境変数が使用されます。 この変数が定義されていない場合、user.nameプロパティが使用されます。 Kerberos が有効になっている場合、これら 3 つの値のいずれかが上書きされます。トンネリングを有効にする (NameNode 操作のみ)。 このオプションは、リモートホストへの SSH トンネルを作成します。 これは、ターゲットサーバーがプライベートネットワーク内にあるものの、ネットワーク内のホストへの SSH 接続が利用できる場合に便利です。 現在、SSH トンネリングは、ファイルのリスト、メタ情報の取得の NameNode を持つオペレーターに対してのみ機能します。

チェックボックスを選択し、SSH 接続の構成を指定します(... をクリックして新しい SSH 構成を作成します)。

拡張接続設定 で、以下をセットアップできます。

ルートパス: HDFS 接続のルートになるターゲットサーバー上のパス。

動作タイムアウト (秒): ファイル情報の取得、オブジェクトの一覧表示または削除など、リモートストレージで実行される操作のタイムアウト(秒単位)を入力します。 デフォルト値は 15 秒です。

設定を入力したら、 接続のテスト をクリックして、すべての構成パラメーターが正しいことを確認します。 次に OK をクリックします。

接続が正常に確立されると、 ドライバーのホームパス フィールドには、ポート番号を含む接続のターゲット IP アドレスが表示されます。 例: hdfs://127.0.0.1:65224/ 。

Hadoop ファイルシステムの構成ファイルのサンプル

タイプ | サンプル構成 |

|---|---|

HDFS |

<?xml version="1.0"?>

<configuration>

<property>

<name>fs.hdfs.impl</name>

<value>org.apache.hadoop.hdfs.DistributedFileSystem</value>

</property>

<property>

<name>fs.defaultFS</name>

<value>hdfs://example.com:9000/</value>

</property>

</configuration>

|

S3 |

<?xml version="1.0"?>

<configuration>

<property>

<name>fs.s3a.impl</name>

<value>org.apache.hadoop.fs.s3a.S3AFileSystem</value>

</property>

<property>

<name>fs.s3a.access.key</name>

<value>sample_access_key</value>

</property>

<property>

<name>fs.s3a.secret.key</name>

<value>sample_secret_key</value>

</property>

<property>

<name>fs.defaultFS</name>

<value>s3a://example.com/</value>

</property>

</configuration>

|

WebHDFS |

<?xml version="1.0"?>

<configuration>

<property>

<name>fs.webhdfs.impl</name>

<value>org.apache.hadoop.hdfs.web.WebHdfsFileSystem</value>

</property>

<property>

<name>fs.defaultFS</name>

<value>webhdfs://master.example.com:50070/</value>

</property>

</configuration>

|

WebHDFS と Kerberos |

<?xml version="1.0"?>

<configuration>

<property>

<name>fs.webhdfs.impl</name>

<value>org.apache.hadoop.hdfs.web.WebHdfsFileSystem</value>

</property>

<property>

<name>fs.defaultFS</name>

<value>webhdfs://master.example.com:50070</value>

</property>

<property>

<name>hadoop.security.authentication</name>

<value>Kerberos</value>

</property>

<property>

<name>dfs.web.authentication.kerberos.principal</name>

<value>testuser@EXAMPLE.COM</value>

</property>

<property>

<name>hadoop.security.authorization</name>

<value>true</value>

</property>

</configuration>

|