カスタム Spark クラスター

Spark Submit 実行構成では、AWS EMR または Dataproc をリモートサーバーとして使用し、アプリケーションを実行できます。 これら 2 つのオプションに加えて、独自のカスタム Spark クラスターも構成できます。SSH 構成を設定してリモートサーバーへ接続し、必要に応じて Spark History サーバーや SFTP 接続も構成してください。

カスタム Spark クラスターの作成

「Big Data Tools 」ウィンドウで「

」をクリックし、「カスタム Spark クラスター 」を選択します。

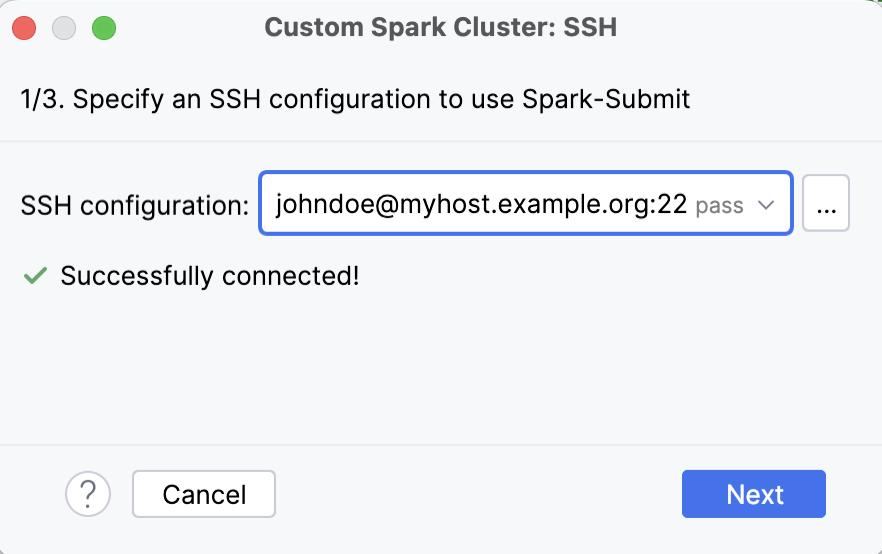

表示されるウィンドウの最初のステップで、SSH 構成を選択し、 次へ をクリックします。 この SSH 構成は、spark-submit がインストールされているサーバーへの接続に使用されます。

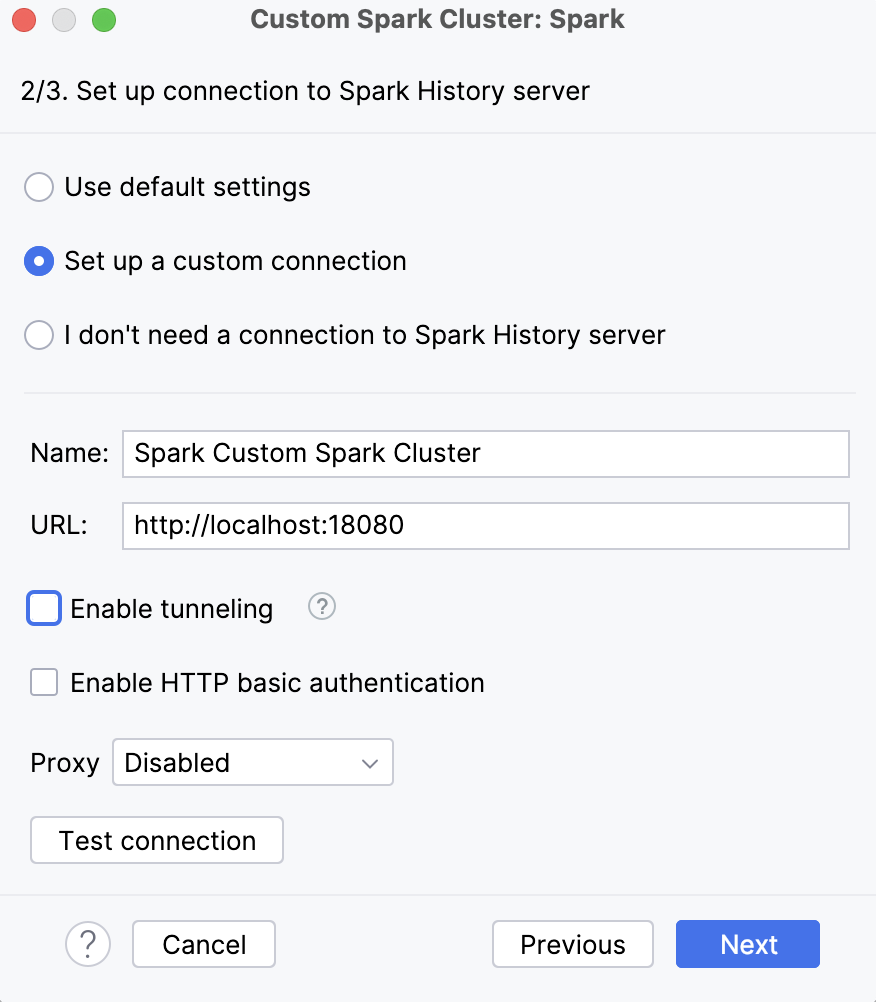

IDE 内で Spark ジョブをモニタリングする場合は、ウィザードの 2 番目のステップで Spark history サーバーへの接続を確立するためのパラメーターを指定してください。 カスタムパラメーターを指定するか、デフォルト設定を使用してください。デフォルト設定では、SSH トンネリングを利用して

localhost:18080への接続が作成されます。それ以外の場合は、 Spark 履歴サーバーへの接続は必要ありません を選択します。

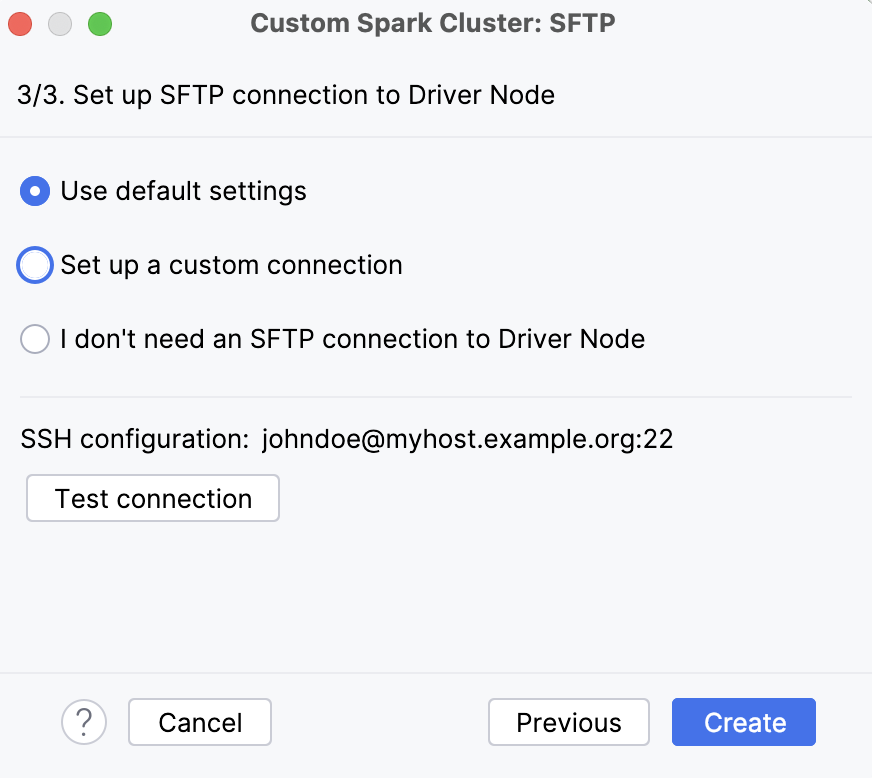

Spark クラスターへの SFTP 接続が必要な場合は、ウィザードの 3 番目のステップでその設定を指定します。

それ以外の場合は、 ドライバーノードへの SFTP 接続は必要ありません を選択します。

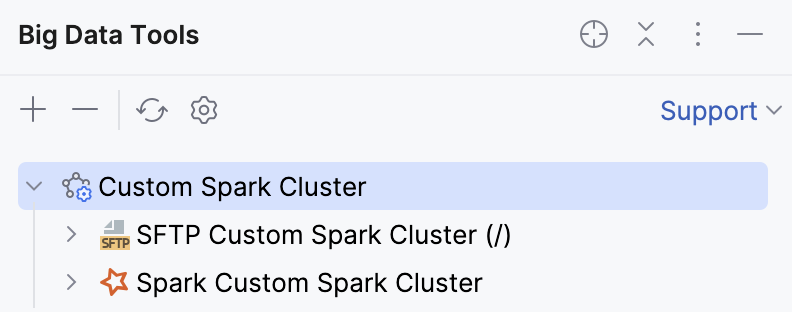

Spark 履歴と SFTP 接続の両方を設定している場合は、 Big Data Tools ツールウィンドウの カスタム Spark クラスター で使用できるようになります。

これで、このクラスターを Spark Submit 実行構成のリモートターゲットとして選択できるようになりました。 この実行構成を起動すると、アプリケーション出力のリンクをクリックして、 サービス ツールウィンドウで Spark ジョブを開くことができます。