支持的模型

AI Assistant 使用多种 AI 模型为其功能和 AI Chat 提供支持。 默认情况下,这些模型通过 JetBrains AI 服务 提供,但您也可以使用受支持的第三方提供商的 API 密钥 ,或连接 本地部署模型。

这种灵活性使您可以选择最适合您工作流程和隐私需求的配置方式。

JetBrains AI 服务模型

下表列出了在 AI Assistant 中通过 JetBrains AI 服务 订阅可用的模型:

模型 | 功能 | 模型上下文窗口 |

|---|

Claude 4.6 Opus   Claude 4.6 Opus

|

| 200k |

Claude 4.6 Sonnet   Claude 4.6 Sonnet

|

| 200k |

Claude 4.5 Opus   Claude 4.5 Opus

|

| 200k |

Claude 4.5 Sonnet   Claude 4.5 Sonnet

|

| 200k |

Claude 4.5 Haiku   Claude 4.5 Haiku

|

| 200k |

Claude 4.1 Opus   Claude 4.1 Opus

|

| 200k |

Claude 4 Sonnet   Claude 4 Sonnet

|

| 200k |

Gemini 3.1 Pro   Gemini 3.1 Pro

|

| 1M |

Gemini 3 Flash   Gemini 3 Flash

|

| 1M |

Gemini 2.5 Pro   Gemini 2.5 Pro

|

| 1M |

Gemini 2.5 Flash   Gemini 2.5 Flash

|

| 1M |

Gemini 2.5 Flash-Lite   Gemini 2.5 Flash-Lite

|

| 1M |

Gemini 2.0 Flash   Gemini 2.0 Flash

|

| 1M |

GPT-5.4 mini 小型版   GPT-5.4 mini 小型版

|

| 400k |

GPT-5.4 nano 微型版   GPT-5.4 nano 微型版

|

| 400k |

GPT-5.4 标准版   GPT-5.4 标准版

|

| 1M |

GPT-5.3 Codex 代码版   GPT-5.3 Codex 代码版

|

| 400k |

GPT-5.2 Codex 代码版   GPT-5.2 Codex 代码版

|

| 400k |

GPT-5.2   GPT-5.2

|

| 400k |

GPT-5.1-Codex-Max   GPT-5.1-Codex-Max

|

| 400k |

GPT-5.1-Codex   GPT-5.1-Codex

|

| 400k |

GPT-5.1-Codex-Mini   GPT-5.1-Codex-Mini

|

| 400k |

GPT-5.1   GPT-5.1

|

| 400k |

GPT-5-Codex   GPT-5-Codex

|

| 400k |

GPT-5   GPT-5

|

| 400k |

GPT-5 mini   GPT-5 mini

|

| 400k |

GPT-5 nano   GPT-5 nano

|

| 400k |

GPT-4.1   GPT-4.1

|

| 1M |

GPT-4.1 mini   GPT-4.1 mini

|

| 1M |

GPT-4.1 nano   GPT-4.1 nano

|

| 1M |

GPT-4o   GPT-4o

|

| 128k |

o1   o1

|

| 200k |

o3   o3

|

| 200k |

o3-mini   o3-mini

|

| 200k |

o4-mini   o4-mini

|

| 200k |

Grok-4.1 Fast   Grok-4.1 Fast

|

| 2M |

Grok-4.1 Fast(非推理版)   Grok-4.1 Fast(非推理版)

|

| 2M |

Grok-4   Grok-4

|

| 256k |

Grok Code Fast 1   Grok Code Fast 1

| | 256k |

- 支持模型的历史

下表列出了 AI Assistant 支持的 AI 模型、其在 IDE 中首次可用的版本以及当前状态。

模型 | 从以下版本开始在 IDE 中提供 | 状态 |

|---|

Claude 4.6 Opus   Claude 4.6 Opus

| 2025.3.x | 活动 |

Claude 4.6 Sonnet   Claude 4.6 Sonnet

| 2025.3.x | 活动 |

Claude 4.5 Opus   Claude 4.5 Opus

| 2025.2.x | 活动 |

Claude 4.5 Sonnet   Claude 4.5 Sonnet

| 2025.2.x | 活动 |

Claude 4.5 Haiku   Claude 4.5 Haiku

| 2025.2.x | 活动 |

Claude 4.1 Opus   Claude 4.1 Opus

| 2025.2.x | 活动 |

Claude 4 Sonnet   Claude 4 Sonnet

| 2025.1.x | 活动 |

Claude 3.7 Sonnet   Claude 3.7 Sonnet

| 2024.3.x | 提供商已弃用 |

Claude 3.5 Sonnet   Claude 3.5 Sonnet

| 2024.3.x | 提供商已弃用 |

Claude 3.5 Haiku   Claude 3.5 Haiku

| 2024.3.x | 提供商已弃用 |

Gemini 3.1 Pro   Gemini 3.1 Pro

| 2025.3.x | 活动 |

Gemini 3 Pro   Gemini 3 Pro

| 2025.2.x | 提供商已弃用 |

Gemini 3 Flash   Gemini 3 Flash

| 2025.2.x | 活动 |

Gemini 2.5 Pro   Gemini 2.5 Pro

| 2025.1.x | 活动 |

Gemini 2.5 Flash   Gemini 2.5 Flash

| 2025.1.x | 活动 |

Gemini 2.5 Flash-Lite   Gemini 2.5 Flash-Lite

| 2025.2.x | 活动 |

Gemini 2.0 Flash   Gemini 2.0 Flash

| 2024.3.x | 活动 |

Gemini 1.5 Pro   Gemini 1.5 Pro

| 2024.3.x | 提供商已弃用 |

Gemini 1.5 Flash   Gemini 1.5 Flash

| 2024.3.x | 提供商已弃用 |

GPT-5.4 mini 小型版   GPT-5.4 mini 小型版

| 2025.2.x | 活动 |

GPT-5.4 nano 微型版   GPT-5.4 nano 微型版

| 2025.2.x | 活动 |

GPT-5.4 标准版   GPT-5.4 标准版

| 2025.2.x | 活动 |

GPT-5.3 Codex 代码版   GPT-5.3 Codex 代码版

| 2025.3.x | 活动 |

GPT-5.2 Codex 代码版   GPT-5.2 Codex 代码版

| 2025.3.x | 活动 |

GPT-5.2   GPT-5.2

| 2025.2.x | 活动 |

GPT-5.1-Codex-Max   GPT-5.1-Codex-Max

| 2025.3.x | 活动 |

GPT-5.1-Codex   GPT-5.1-Codex

| 2025.3.x | 活动 |

GPT-5.1-Codex-Mini   GPT-5.1-Codex-Mini

| 2025.3.x | 活动 |

GPT-5.1   GPT-5.1

| 2025.2.x | 活动 |

GPT-5-Codex   GPT-5-Codex

| 2025.3.x | 活动 |

GPT-5   GPT-5

| 2025.2.x | 活动 |

GPT-5 mini   GPT-5 mini

| 2025.2.x | 活动 |

GPT-5 nano   GPT-5 nano

| 2025.2.x | 活动 |

GPT-4.1   GPT-4.1

| 2025.1.x | 活动 |

GPT-4.1 mini   GPT-4.1 mini

| 2025.1.x | 活动 |

GPT-4.1 nano   GPT-4.1 nano

| 2025.1.x | 活动 |

GPT-4o   GPT-4o

| 2024.2.x | 活动 |

o4-mini   o4-mini

| 2025.1.x | 活动 |

o3   o3

| 2025.1.x | 活动 |

o3-mini   o3-mini

| 2024.3.x | 活动 |

o1   o1

| 2024.3.x | 活动 |

o1-mini   o1-mini

| 2024.3.x | 提供商已弃用 |

Grok-4.1 Fast   Grok-4.1 Fast

| 2025.2.x | 活动 |

Grok-4.1 Fast(非推理版)   Grok-4.1 Fast(非推理版)

| 2025.2.x | 活动 |

Grok-4   Grok-4

| 2025.2.x | 活动 |

Grok Code Fast 1   Grok Code Fast 1

| 2025.2.x | 活动 |

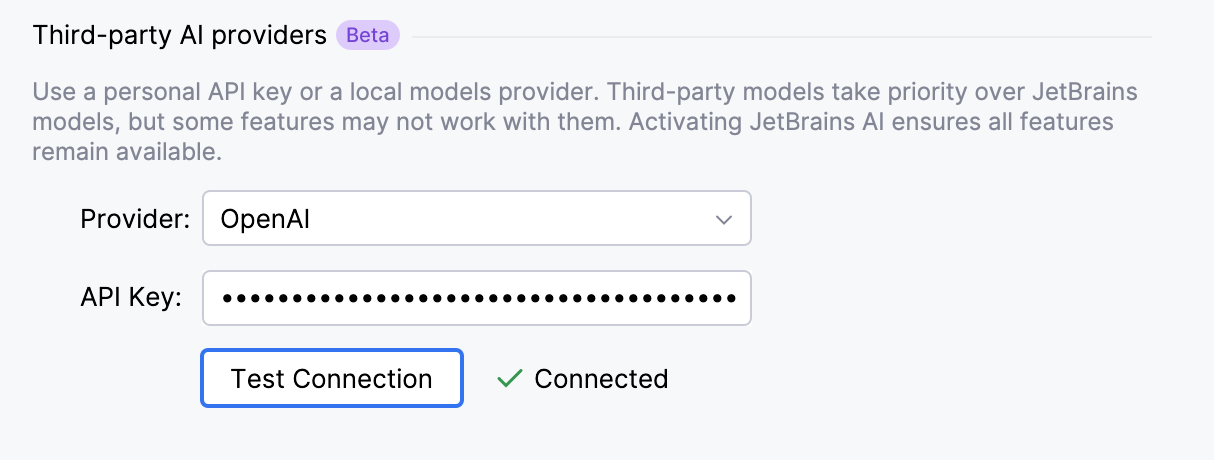

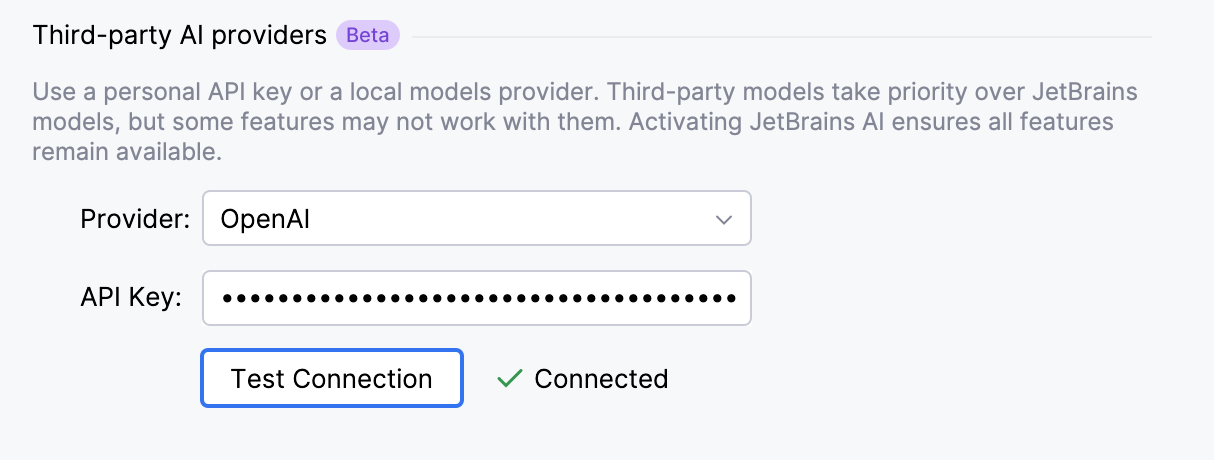

来自第三方 AI 提供商的模型

AI Assistant 支持自有密钥(BYOK)方式,您可使用自己的 API 密钥访问支持的第三方 AI 提供商的模型。 通过 BYOK,无需 JetBrains AI 服务订阅也可使用支持的 AI Assistant 功能。

可在 配置 中设置连接。

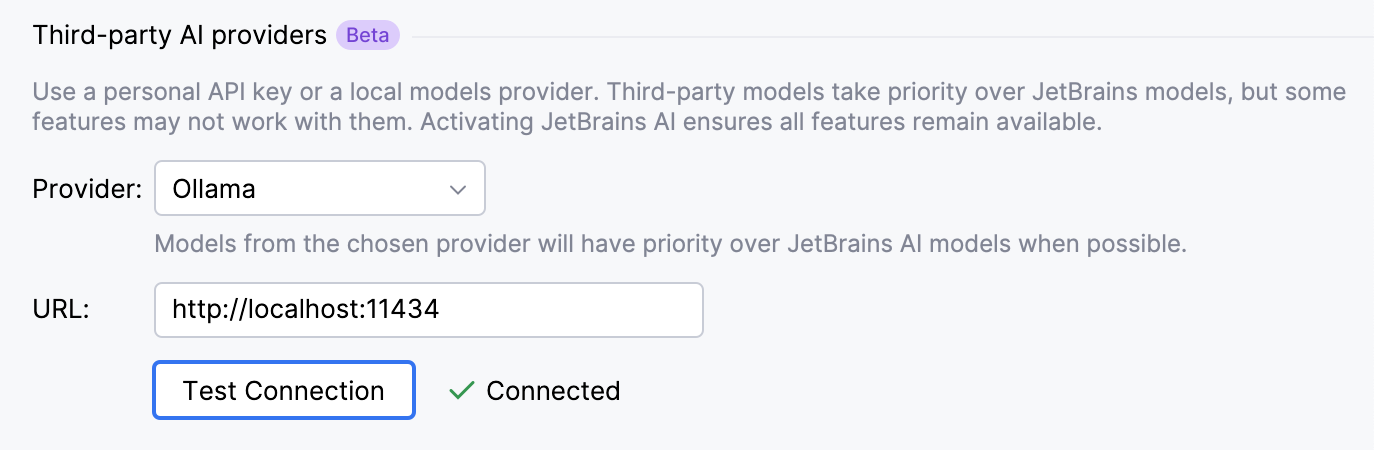

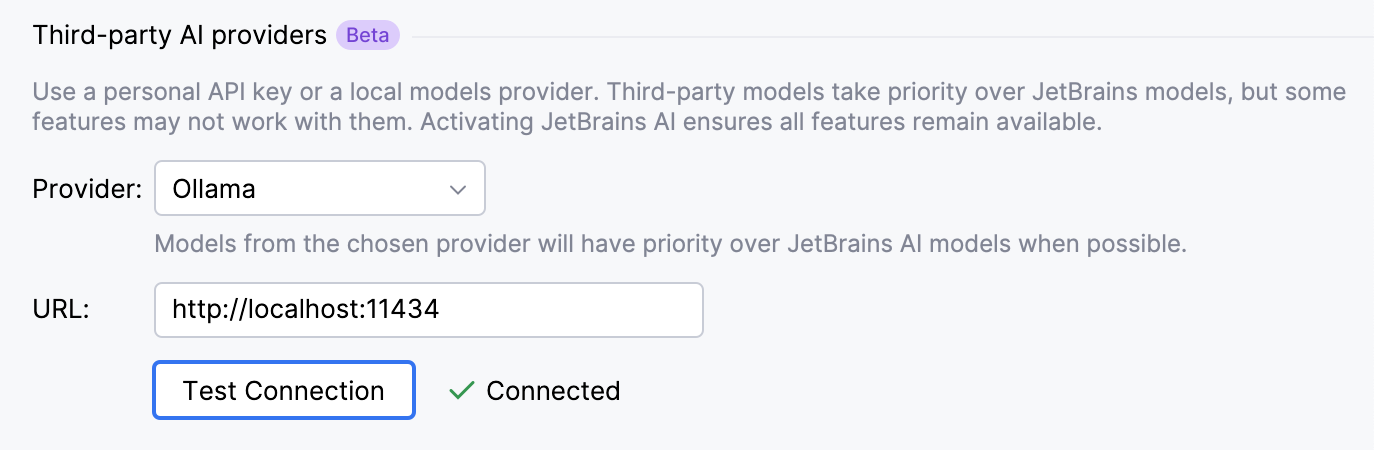

本地模型

如果您希望数据保留在本地设备,或者想要尝试本地部署的模型,本地运行模型会很有用。

AI Assistant 支持可通过 Ollama 和 LM Studio 在本地计算机上运行的部分模型。 通过这种方式,可以在不依赖云服务的情况下使用由 AI 驱动的功能。

可在 配置 中设置连接。

2026年 5月 8日

– 这些模型更适合需要逻辑推理、结构化输出或深度上下文理解的任务。

—— 这些模型能够处理图像,支持为请求添加可视化上下文。