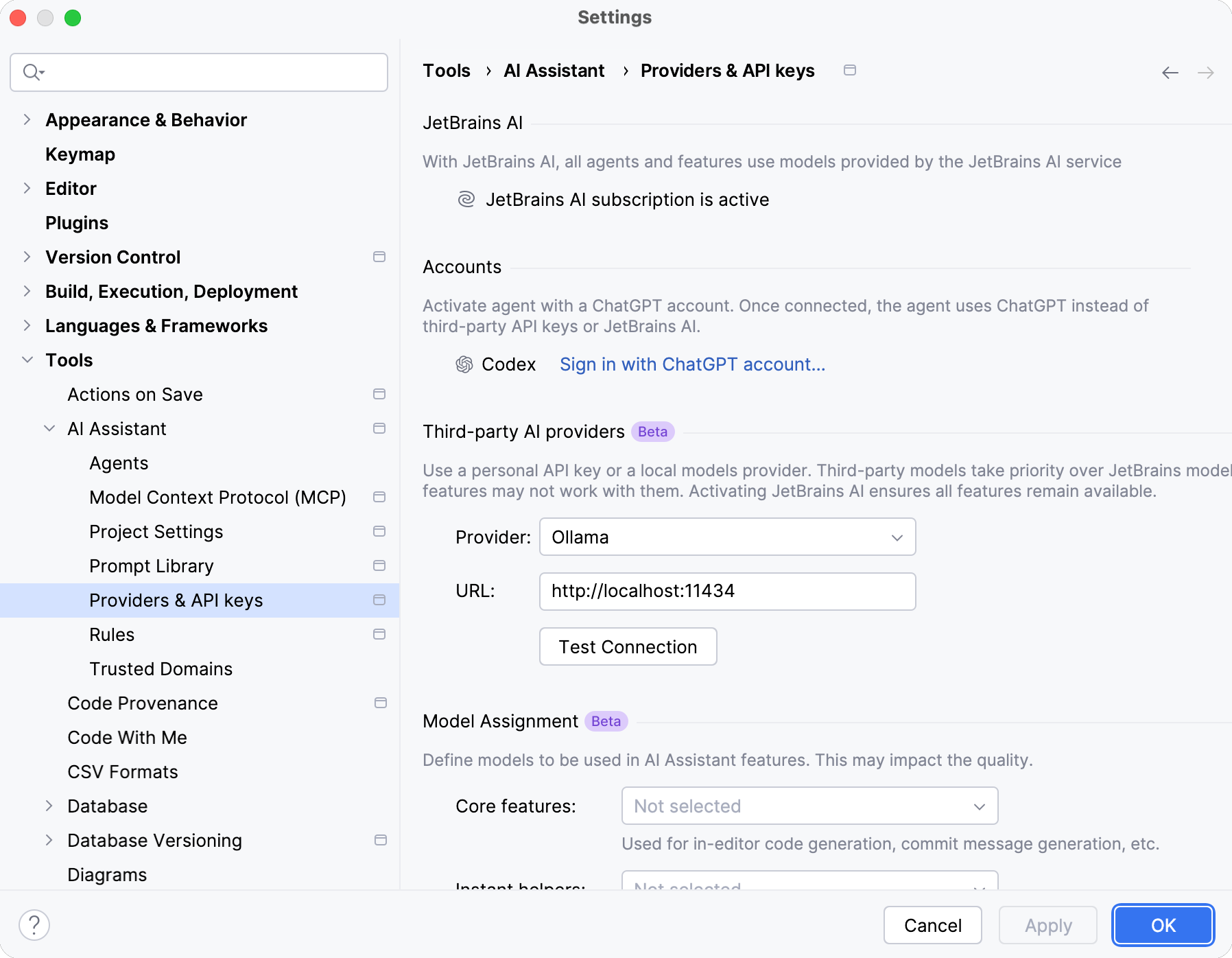

服务提供商和API密钥

请在此页面 配置对第三方 AI 提供商和本地部署模型的访问,并管理对 集成代理的授权。

JetBrains AI

项目 | 描述 |

|---|---|

激活 JetBrains AI | 如果您正在将 AI Assistant 与 第三方 AI 服务商的模型一起使用,并希望另外激活 JetBrains AI 以确保 全部功能,或者如果您之前已 退出 JetBrains AI 账户并需要重新登录,请点击 激活 JetBrains AI 按钮。 |

注销 | 如需使用其他 激活选项 ,可点击 注销 退出 JetBrains AI 订阅。 |

如需更多信息,请参阅 与自定义模型一同启用 JetBrains AI。

智能体授权

项目 | 描述 |

|---|---|

使用 ChatGPT 账号登录 | 如需 使用 ChatGPT 账户进行身份验证以使用 Codex确定码库 代理,请点击 使用 ChatGPT 账号登录 按钮。 这允许您使用该代理,但其他 AI Assistant 功能仍不可用。 |

注销 | 如果您想退出 ChatGPT 账户,请点击 注销。 |

撤销 | 如果此前使用支持的 身份验证方法激活过代理,请点击 撤销 移除授权。 |

如需更多信息,请参阅 激活智能体。

第三方 AI 提供商

项目 | 描述 |

|---|---|

提供商 | 请选择要使用其自定义模型的第三方 AI 提供商(Anthropic、 Gemini、 Google Vertex AI、 OpenAI、 OpenAI 兼容、 LM Studio 或 Ollama)。 |

API 密钥 | 请指定用于访问所选第三方 AI 提供商所提供模型的 API 密钥。 |

ADC | 使用应用程序默认凭据(ADC)和环境中配置的凭据(例如,从本地 Google Cloud 设置或服务帐号),为 Google Vertex AI 请求进行身份验证。 仅适用于 Google Vertex AI。 此方法还需要指定 项目 ID 和 位置。 |

URL | 请指定提供商 API 端点的 URL。 此处可以指向本地服务器(例如, |

工具调用 | 请指定该模型是否支持通过 模型上下文协议(MCP) 配置的工具调用。 仅适用于兼容 OpenAI 的提供商。 |

如需更多信息,请参阅 使用第三方和本地模型。。

模型赋值

项目 | 描述 |

|---|---|

核心功能 | 请选择必须用于编辑器内代码生成、提交消息生成、作为聊天默认模型以及其他核心功能的自定义模型。 |

即时帮助程序 | 请选择必须用于轻量级功能(如聊天上下文收集、聊天标题生成和名称建议)的自定义模型。 |

补全模型 | 选择必须用于 内联代码补全的自定义模型。 仅适用于 Fill-in-the-Middle (FIM) 模型。 |

上下文窗口 | 为本地模型指定 模型上下文窗口的大小。 此设置决定模型一次可处理多少上下文信息。 较大的窗口允许更多上下文,而较小的窗口可减少内存使用情况并可能提升性能。 默认情况下,上下文窗口设置为 64 000 个标记。 如需更多信息,请参阅 为 AI 助理功能分配模型。 |

如需更多信息,请参阅 为 AI 助理功能分配模型。